Die britischen Faktenprüfer schicken ihre KI, um den Amerikanern bei der Berichterstattung über Wahlen zu helfen

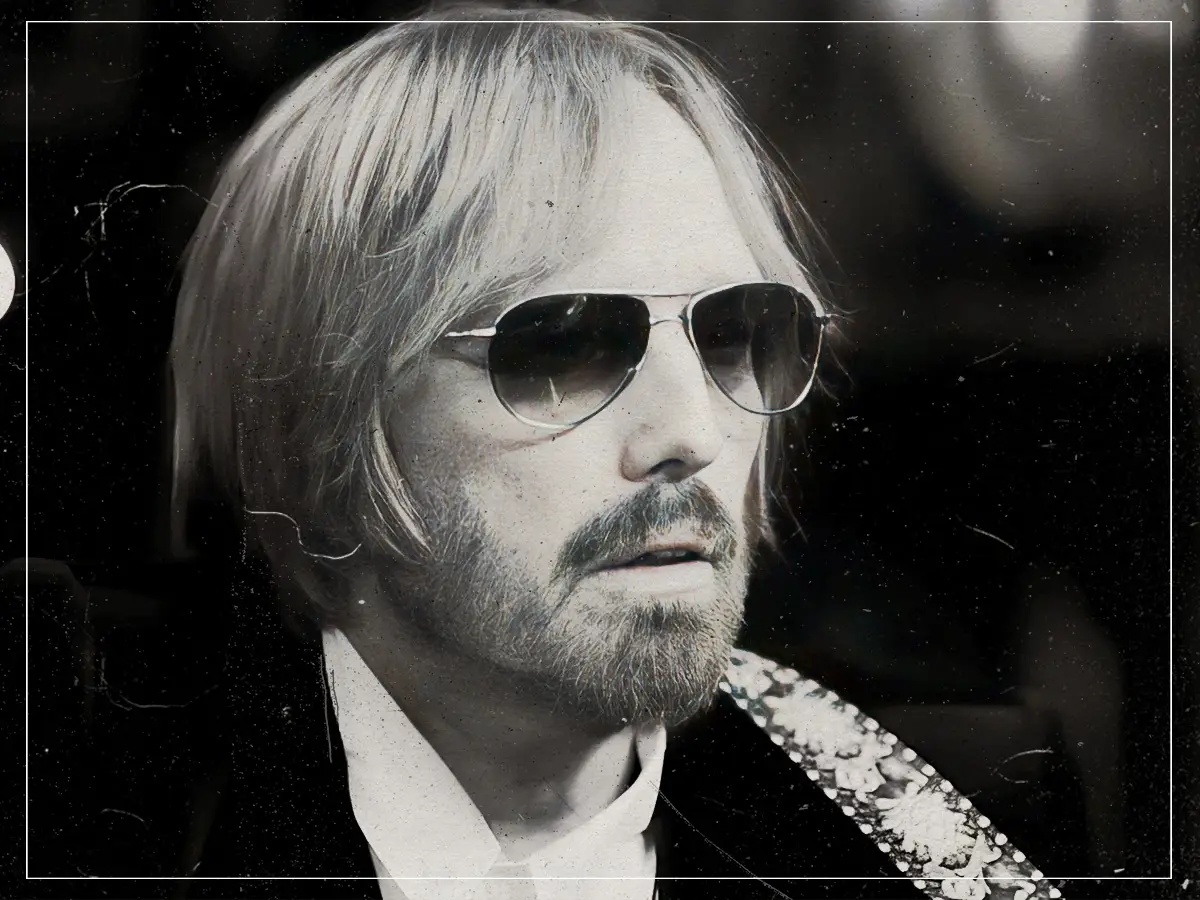

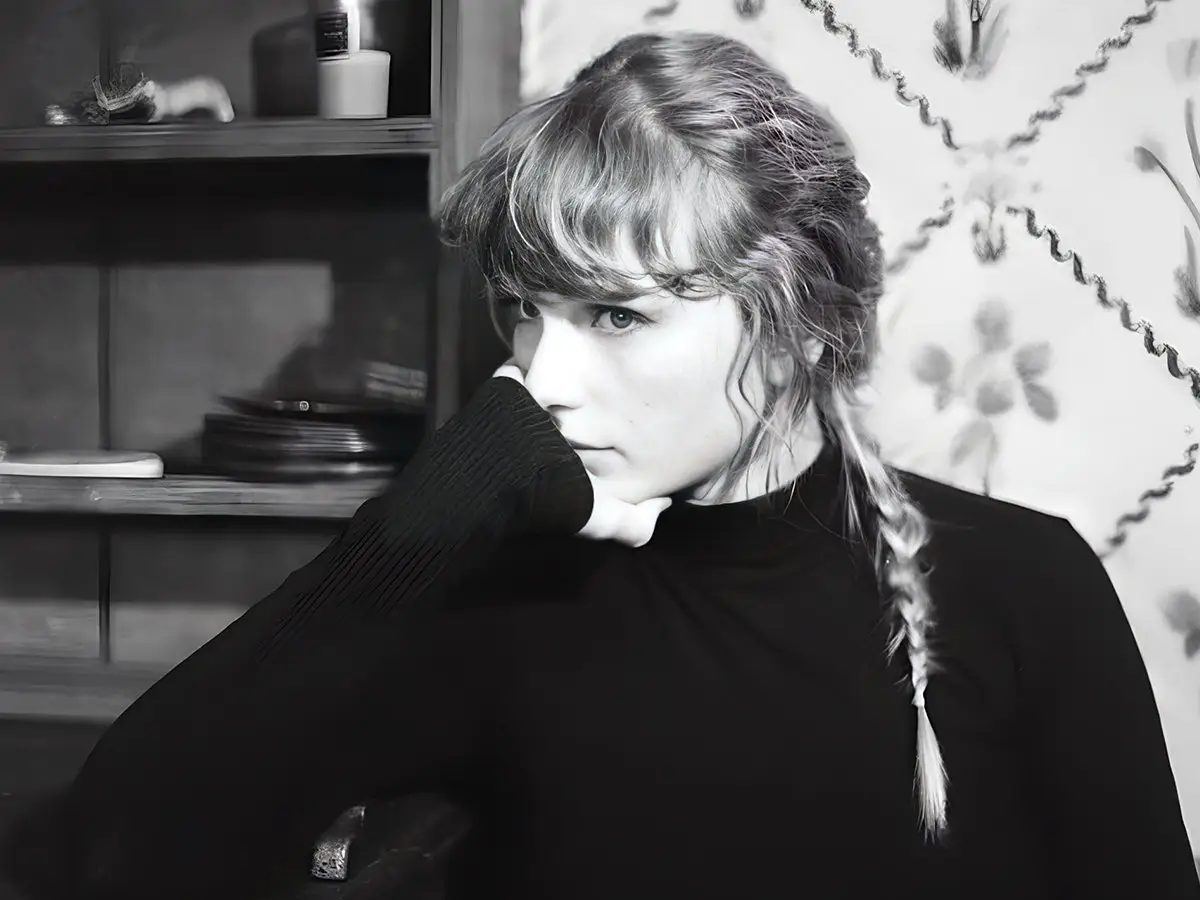

Von links: Andy Dudfield, Leiter AI bei Full Fact, Senior Product Manager Kate Wilkinson, und Senior Data Scientist David Corney. (Mit freundlicher Genehmigung von Full Fact)

Von links: Andy Dudfield, Leiter AI bei Full Fact, Senior Product Manager Kate Wilkinson, und Senior Data Scientist David Corney. (Mit freundlicher Genehmigung von Full Fact)In einem bescheidenen Büro in der Nähe der London Bridge hat ein kleines Team aus Ingenieuren und Faktenprüfern ein Jahrzehnt damit verbracht, KI-Tools und -Modelle zu verfeinern, um das zu tun, was die meisten Journalisten nicht mehr schaffen: mitzuhalten. Das System liest Schlagzeilen, transkribiert Sendungen und durchsucht soziale Medien nach überprüfbaren Behauptungen. Es markiert diejenigen, die am wahrscheinlichsten irreführen oder Schaden anrichten.

Die von Full Fact, der führenden britischen Wohltätigkeitsorganisation für Faktenprüfung, entwickelte Technologie überquert den Atlantik. Im Vorfeld der US-Zwischenwahlen im Jahr 2026, bei denen viele Fehlinformationsexperten davon ausgehen, dass sie durch von KI erzeugte Unwahrheiten bestimmt werden, lädt Full Fact amerikanische Nachrichtenredaktionen ein, seine Tools zu testen, während das Unternehmen nach Finanzmitteln für den Ausbau seiner Arbeit in den USA sucht.

Full Fact wurde 2009 gegründet und begann mit Technologieexperimenten, lange bevor große Sprachmodelle weltweite Aufmerksamkeit erregten. Im Jahr 2016 hatten die Verantwortlichen erkannt, dass menschliche Faktenprüfer nicht mehr jede Sendung oder Plattform auf fragwürdige Behauptungen zu Themen von öffentlichem Interesse überwachen konnten. Als Andy Dudfield 2019 der Organisation beitrat, um die KI-Arbeit zu leiten, gründete er ein kleines Team schon erkunden wie Automatisierung helfen könnte.

Die Technologie von Full Fact entstand aus der frühen Verarbeitung natürlicher Sprache vor den heutigen generativen Modellen. Das Team begann damit, Systeme zu trainieren, um überprüfbare Aussagen zu identifizieren und sie mit vorhandenen Faktenchecks abzugleichen. Im Jahr 2019 haben Ingenieure das BERT von Google verfeinert – ein Modell, das darauf ausgelegt ist, Sprache zu verstehen, anstatt sie zu generieren –, um Anspruchstypen in Nachrichten und sozialen Medien zu kennzeichnen.

Mit Zehntausenden menschlichen Anmerkungen lernte das Modell, riesige Textströme zu selektieren, mehr als 300.000 Sätze pro Tag zu verarbeiten und neue Behauptungen zu kennzeichnen, die in anderen Formulierungen wieder auftauchten. In den letzten zwei Jahren sind größere generative Modelle hinzugekommen, die potenzielle Schäden abschätzen und paraphrasierte Versionen abfangen, die alten Systemen entgehen würden. Die neuen Systeme bringen wahrscheinlich schädliche Fehlinformationen ans Licht und gruppieren sie. Faktenprüfer entscheiden, was untersucht und veröffentlicht werden soll.

Benutzer greifen auf die Tools über ein Web-Dashboard zu, das Behauptungen aus Nachrichten, Social-Media-Podcasts, Videos und Radio anzeigt. Die Benutzeroberfläche ist mit Originalclips oder -beiträgen verknüpft und ermöglicht Teams die Suche nach Thema oder Sprecher, um zu sehen, wo Behauptungen aufgetaucht sind, und um Benachrichtigungen zu erhalten, wenn widerlegte Aussagen wieder auftauchen. Wenn es aktiviert ist, kann das System wahrscheinlich schädliche Ansprüche priorisieren, sodass Redakteure entscheiden können, woran sie zuerst arbeiten möchten.

Alles, was wir an Technologie gebaut haben, geschieht unter dem Gesichtspunkt, von Faktenprüfern für Faktenprüfer entwickelt zu werden, sagte Dudfield mir. Wir haben nicht versucht, herauszufinden, welche Technologie cool wäre. Wir haben versucht, die tatsächlichen Probleme herauszufinden, die wir bei der Faktenprüfung hatten, und herauszufinden, ob die Technologie helfen könnte.

Diese Auszeichnung machte Full Fact AI zu einem achtköpfigen Team, das im Mittelpunkt der Arbeit der Wohltätigkeitsorganisation steht. Das System analysiert den potenziellen Schaden einer Behauptung, indem es abwägt, wie falsch sie ist, wie glaubwürdig sie klingt und wie wahrscheinlich es ist, dass sie Menschen dazu veranlasst, entsprechend zu handeln.

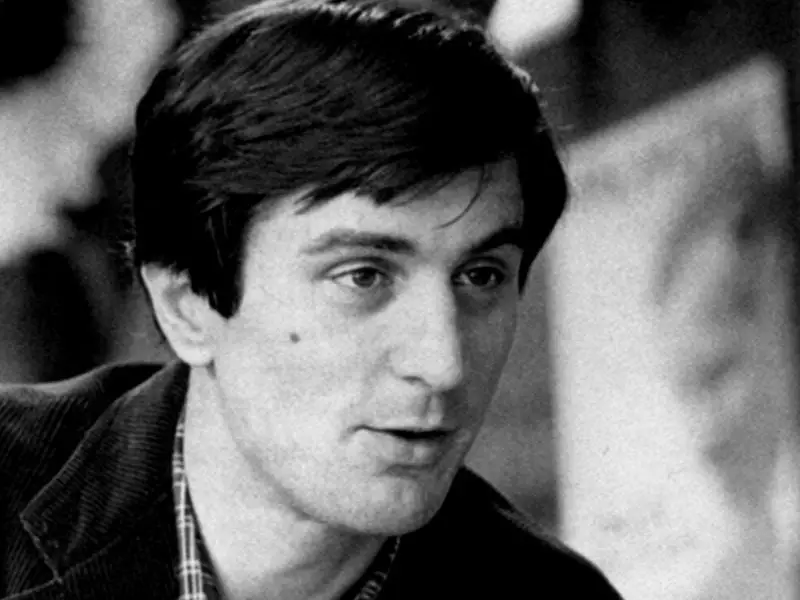

Das Schadensmodell basiert auf Forschungen von Peter Cunliffe-Jones, dem Gründer von Africa Check und Autor von Fake News: What’s the Harm? In diesem von der University of Westminster Press veröffentlichten Buch geht Cunliffe-Jones nach, wie Unwahrheiten messbare Folgen haben können – von Mob-Angriffen auf Gesundheitspersonal während des Ebola-Ausbruchs 2014 bis hin zu Lynchmorden in Indien, die durch WhatsApp-Hoaxes über Kindesentführer angeheizt wurden. Zwischen 2021 und 2025 entwickelte er ein Modell, um vorherzusagen, welche falschen Behauptungen am wahrscheinlichsten zu echtem Schaden führen würden.

„Faktenprüfer müssen sich darauf konzentrieren, was am wahrscheinlichsten echten Schaden anrichtet, und nicht nur darauf, was falsch ist“, sagte mir Cunliffe-Jones in einer E-Mail. Das Schadensbewertungs-Framework von Full Fact wendet dieses Modell in großem Maßstab an und hilft Faktenprüfern dabei, begrenzte Ressourcen dorthin zu lenken, wo sie am wichtigsten sind.

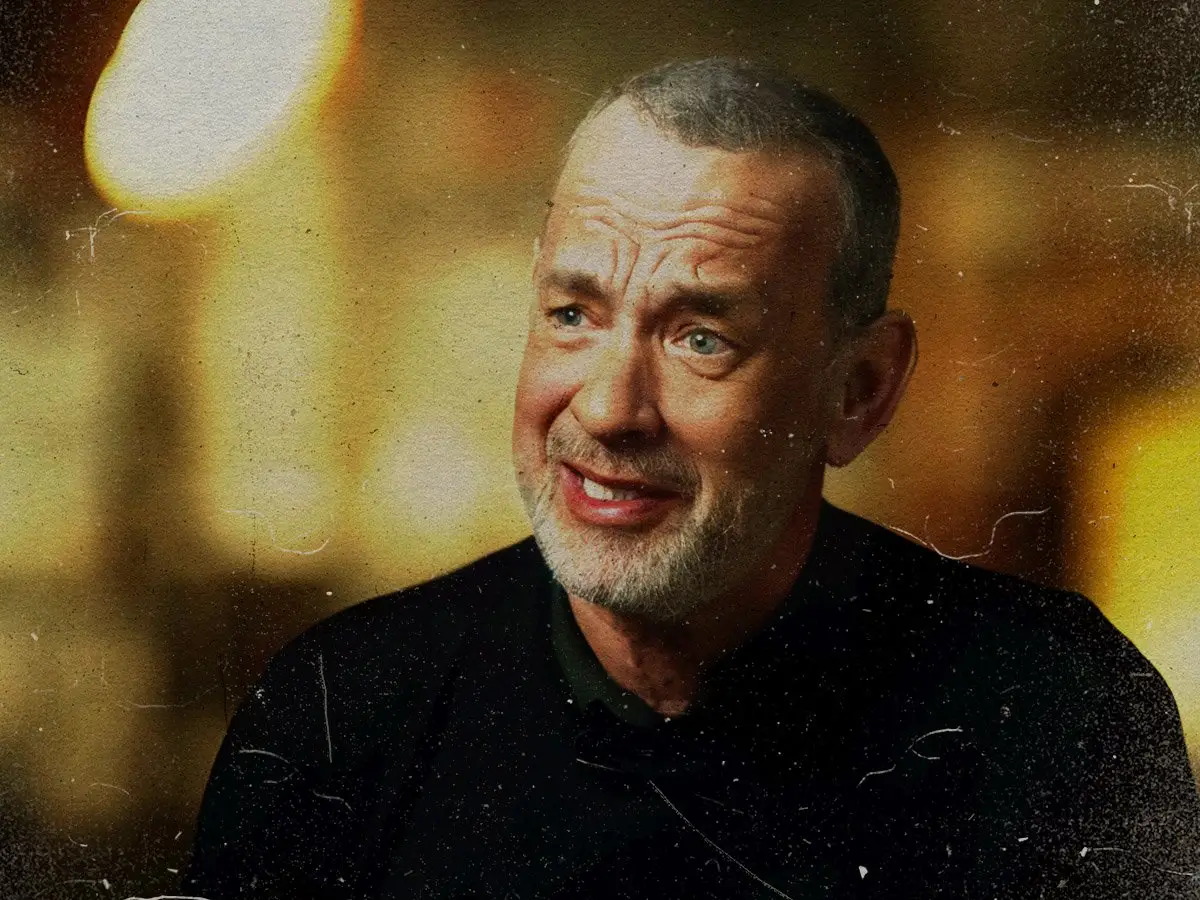

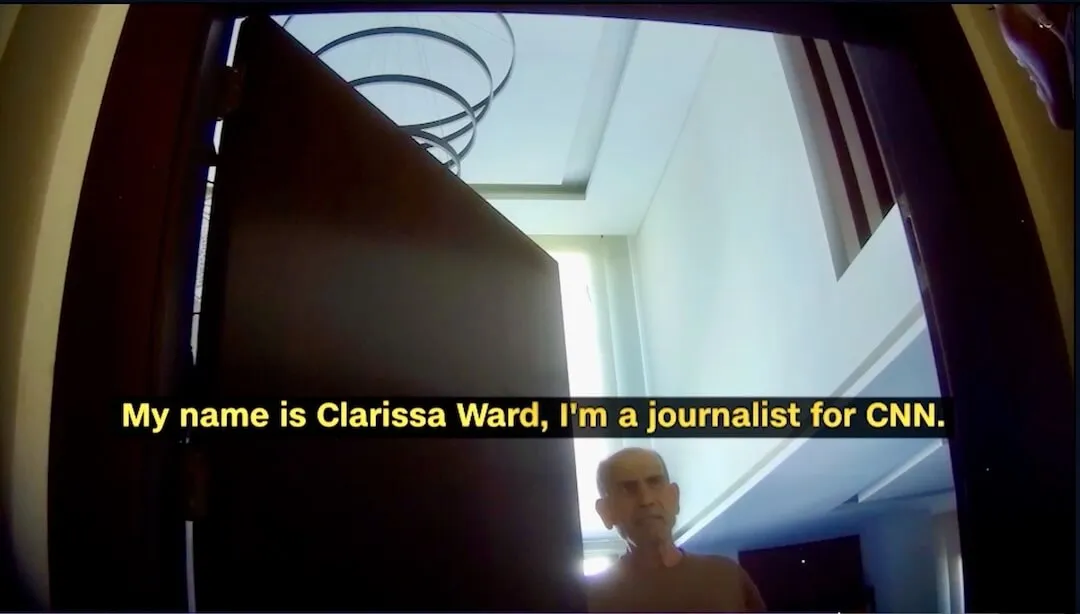

Die Tools wurden von mehr als 40 Organisationen zur Faktenprüfung in über 30 Ländern eingesetzt, unter anderem während der Präsidentschaftswahl 2023 in Nigeria Faktenprüfer setzten sie ein, um virale Behauptungen in Echtzeit zu verfolgen und zu entkräften . Das System sei eine Co-Intelligenz zwischen Mensch und Maschine, sagte Kate Wilkinson, leitende Produktmanagerin von Full Fact, die die Öffentlichkeitsarbeit in den US-Nachrichtenredaktionen leitet.

Unsere Tools seien nicht dazu gedacht, Faktenprüfer zu ersetzen, sagte Wilkinson. Sie nehmen Ihnen die wirklich zeit- und ressourcenintensive Aufgabe der Medienüberwachung ab.

Full Fact hat damit begonnen, US-amerikanische Faktenprüfstellen von lokalen Teams bis hin zu nationalen Netzwerken einzuladen, um seine KI-Tools vor den Wahlen im nächsten Jahr zu testen. Wilkinson bezeichnete den Zeitpunkt als angemessen und sagte, die Plattform könne Nachrichtenredaktionen dabei helfen, Wahlklagen in großem Umfang zu bearbeiten, ohne dass zusätzliches technisches Personal erforderlich sei. Der Rollout umfasst subventionierte Lizenzen und kurze Onboarding-Sitzungen, um Teams dabei zu helfen, die Tools schnell in ihre tägliche Arbeit zu integrieren.

Der Schritt erfolgt, da viele gemeinnützige und unabhängige Nachrichtenredaktionen mit zunehmenden finanziellen Belastungen konfrontiert sind und gleichzeitig damit experimentieren, wie KI ihnen dabei helfen kann, ihr Publikum besser zu bedienen. In der Meta der Vereinigten Staaten beendet Das Programm zur Überprüfung von Fakten durch Dritte im Januar zwang mehrere Filialen zur Verkleinerung und veranlasste fast ein Drittel der vom International Fact-Checking Network akkreditierten Organisationen zur Schließung.

Vor zwei Wochen gab Full Fact bekannt, dass Google seine langjährige Unterstützung für die KI-Arbeit der Wohltätigkeitsorganisation zurückgezogen hat. Die Organisation sagte, sie habe im vergangenen Jahr mehr als 1 Million Pfund von Google erhalten, entweder direkt oder über entsprechende Mittel, die nun alle eingestellt wurden.

Dudfield nannte den Verlust erheblich, aber nicht unüberwindbar. „Technologie ist nichts, was wir bei Full Fact nebenbei machen“, sagte er. Es ist der Kern dessen, was wir tun.

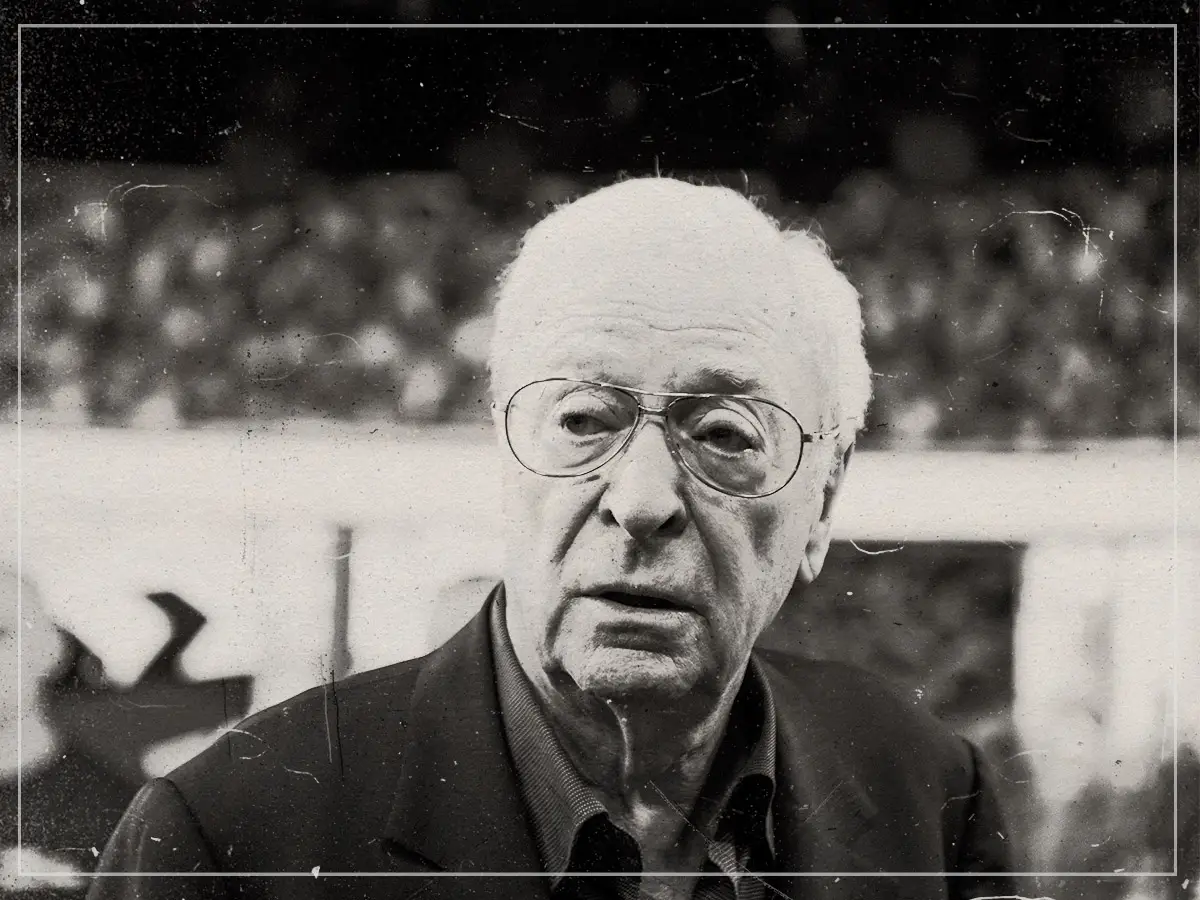

In einer Erklärung sagte der Vorstandsvorsitzende von Chris Morris Full Fact, dass die Wohltätigkeitsorganisation ihre Spendensammlung dringend neu ausrichten und gleichzeitig unabhängig bleiben müsse. Morris, der erste On-Air-Faktenprüfer der BBC, kritisierte auch, was er als politische Abkühlung aus dem Silicon Valley bezeichnete. Wir glauben, dass die Entscheidungen von Google und anderen großen US-amerikanischen Technologieunternehmen von dem wahrgenommenen Bedürfnis beeinflusst werden, der aktuellen US-Regierung zu gefallen, sagt er schrieb . Die vollständigen Fakten werden immer klar sein: Überprüfbare Fakten sind wichtig und die großen Internetunternehmen tragen Verantwortung, wenn es darum geht, die Verbreitung schädlicher Fehlinformationen einzudämmen.

Die Mittelkürzungen folgen a breiterer Rückzug großer Technologieunternehmen von der Unterstützung der Faktenprüfung weltweit. Dudfield sagte, das sich verändernde Umfeld habe die Mission seines Teams bestärkt, Technologie zur Aufrechterhaltung einer unabhängigen Verifizierung einzusetzen. „Wir werden weiterhin Technologie zur Unterstützung der Faktenprüfung einsetzen, weil wir glauben, dass wir dort den größten Unterschied machen können“, sagte er.

„Die Erweiterung von Full Fact kommt zu einem entscheidenden Zeitpunkt für die Faktenprüfung“, sagte Lucas Graves, Journalistikprofessor an der University of Wisconsin-Madison und Autor von „Deciding What’s True: The Rise of Political Fact-Checking in American Journalism“.

Er sagte, dass in der gesamten Medienlandschaft der USA in großen und kleinen Nachrichtenredaktionen viel mit KI experimentiert werde. Aber was Full Fact hat, ist eine speziell entwickelte Plattform, die über fast ein Jahrzehnt hinweg entwickelt wurde, um Fehlinformationen zu verfolgen und zu priorisieren – ein Bereich, in dem die meisten Nachrichtenredaktionen nicht über viel Erfahrung verfügen.

Graves nannte die Ausweitung einen guten Zeitpunkt und fügte hinzu, dass die Bedrohung durch Online-Fehlinformationen schnell zunehme, während die Ressourcen der Nachrichtenredaktionen immer weiter schrumpften.

Trotz politischer Veränderungen und sinkender Unterstützung für die Branche sagte Dudfield, dass sich das Ziel nicht geändert habe. Wir sind Faktenprüfer. Wir überprüfen die Fakten, die er gesagt hat. Die Arbeit, Unwahrheiten aufzudecken, fügte er hinzu, bleibe von entscheidender Bedeutung, auch wenn der Druck auf unabhängige Journalisten zunehme. Die Alternative, sagte er, würde weitaus mehr kosten.